帶有域?qū)箤W習的多級模態(tài)間和模態(tài)內(nèi)Transformer網(wǎng)絡(luò)用于多模態(tài)睡眠分期

中文題目:帶有域?qū)箤W習的多級模態(tài)間和模態(tài)內(nèi)Transformer網(wǎng)絡(luò)用于多模態(tài)睡眠分期

論文題目:Multilevel Inter-modal and Intra-modal Transformer Network with Domain Adversarial Learning for Multimodal Sleep Staging

錄用期刊:Cognitive Neurodynamics(中科院大類三區(qū))

錄用時間:2025.04.15

作者列表:

1)何洋洋 中國石油大學(北京)人工智能學院 控制工程 碩22級

2)劉建偉 中國石油大學(北京)人工智能學院 自動化系 教師

摘要:

睡眠分期是睡眠相關(guān)疾病診斷過程中的重要環(huán)節(jié),是了解睡眠過程的關(guān)鍵,主要基于整晚的腦電圖睡眠信號等時間序列來精準劃分睡眠階段。傳統(tǒng)上人工視覺觀察睡眠信號并依據(jù)醫(yī)學專業(yè)知識識別的方法效率低下。隨著生物傳感技術(shù)和深度學習技術(shù)的發(fā)展,使得通過非侵入式的腦電圖信號(Electroencephalography,EEG)等自動解碼睡眠過程成為可能。然而傳統(tǒng)的基于深度學習的自動睡眠分期方法往往只考慮單模態(tài)的腦電信號,沒有同時考慮對多模態(tài)數(shù)據(jù)的利用,這限制了模型的性能。此外考慮到不同人的個體差異性,不同人的睡眠信號包含不通用的個性化特征會影響模型的泛化能力。為了解決上述問題,本研究設(shè)計了多級Transformer的深度學習架構(gòu)來充分地捕獲睡眠信號中每個模態(tài)內(nèi)的時間依賴性和不同模態(tài)間的相互依賴性。本文還創(chuàng)新地引入了域?qū)箤W習方法來提高模型泛化性能。本文的實驗結(jié)果表明提出的深度學習模型在多個常用數(shù)據(jù)集上優(yōu)于大多數(shù)基準模型。這一成果為實現(xiàn)高精度的睡眠分期和便攜的家庭睡眠監(jiān)測提供了有力的技術(shù)支撐。

背景與動機:

傳統(tǒng)的基于深度學習的自動睡眠分期方法往往只考慮單模態(tài)的腦電信號,沒有同時考慮對多模態(tài)數(shù)據(jù)的利用,這限制了模型的性能。此外考慮到不同人的個體差異性,不同人的睡眠信號包含不通用的個性化特征會影響模型的泛化能力。

為了解決上述問題,本研究設(shè)計了多級Transformer的深度學習架構(gòu)來充分地捕獲睡眠信號中每個模態(tài)內(nèi)的時間依賴性和不同模態(tài)間的相互依賴性。本文還創(chuàng)新地引入了域?qū)箤W習方法來提高模型泛化性能。

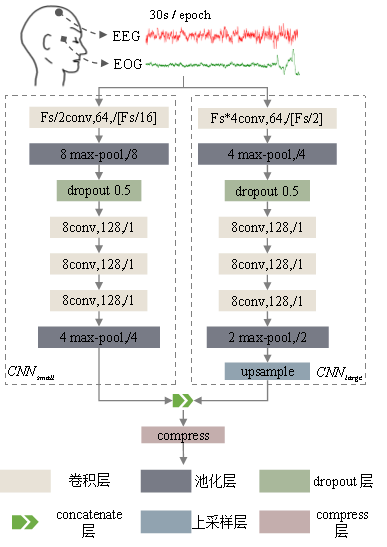

1.多尺度編碼器

圖1 雙尺度的CNN結(jié)構(gòu)圖

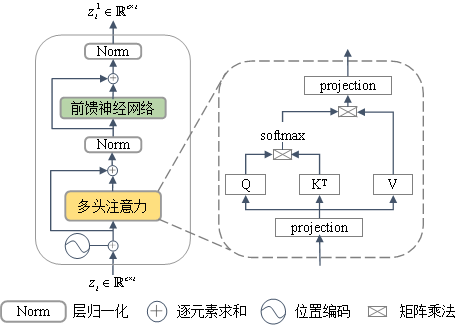

2. 模態(tài)間級Transformer

圖2 模態(tài)間級Transformer編碼器結(jié)構(gòu)

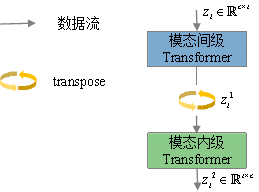

3. 模態(tài)內(nèi)級Transformer

圖3 多級Transformer結(jié)構(gòu)圖

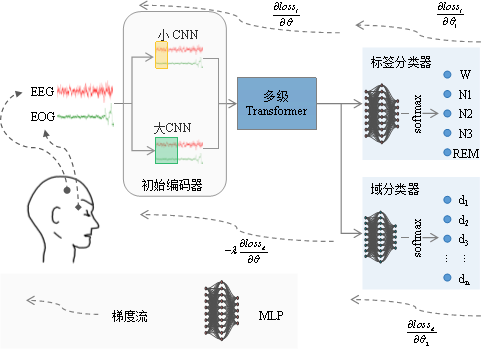

4. 對抗域泛化

圖4 提出的MIIT-DAL模型的整體架構(gòu)

結(jié)論:

在本文中提出了一個新穎的多模態(tài)模型架構(gòu)用于睡眠分期任務(wù),能夠通過域?qū)箤W習策略引導模型學習域無關(guān)特征提升模型泛化能力。首先,該模型利用多尺度CNN去提取時不變特征,實驗結(jié)果證明這是非常有效的。此外,使用了設(shè)計的模態(tài)間Transformer去捕獲模態(tài)間復(fù)雜的非線性依賴關(guān)系和模態(tài)內(nèi)Transformer提取時間依賴關(guān)系。它們以級聯(lián)方式連接去更好地提取模態(tài)間和模態(tài)內(nèi)特征并減少信息冗余。最后結(jié)合了域?qū)箤W習技術(shù)以引導模型學習域無關(guān)特征。在多個公開數(shù)據(jù)集上的實驗結(jié)果表明了該模型很有競爭力。而且,為了強調(diào)各個模塊的重要性,還進行了消融實驗。最終,可視化了該模型和睡眠專家的分類結(jié)果得到了睡眠圖。

作者簡介:

劉建偉,教師,學者。